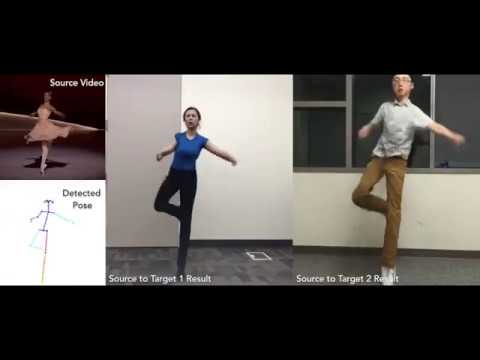

Caroline Chan, Shiry Ginosar, Tinghui Zhou og Alexei A. Efros fra University of Berkeley gir «Alle sammen dans nå» ikke bare en interessant en vitenskapelig papir men også håp for alle bevegelsesdysleksikere hvis dansestil er begrenset til gynging av foten og hodet. Fordi kunstig intelligens i deres tekniske eksperimentelle oppsett hjelper til med å gjengi bevegelsessekvensene til en dansermal så presist som mulig. Du bør i det minste grovt imitere bevegelsene, resten gjøres av datamaskinen. Selvfølgelig ser det fremdeles rudimentært ut og ikke veldig rundt, men det er ganske imponerende.

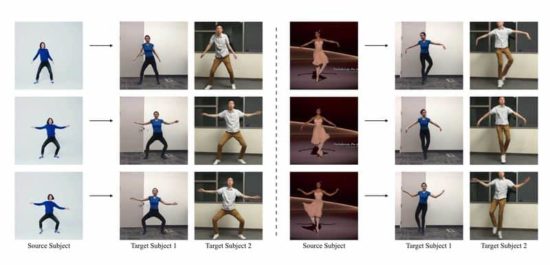

Denne artikkelen presenterer en enkel metode for 'gjør som jeg gjør' bevegelsesoverføring: gitt en kildevideo av en dansende person, kan vi overføre forestillingen til et nytt (amatør) mål etter bare noen få minutter av målobjektet som utfører standardbevegelser. Vi stiller dette problemet som en bilde-til-bilde-oversettelse per ramme med romtemporal utjevning. Ved å bruke posedeteksjoner som en mellomrepresentasjon mellom kilde og mål, lærer vi en kartlegging fra posebilder til et motivs utseende. Vi tilpasser dette oppsettet for tidsmessig sammenhengende videogenerering, inkludert realistisk ansiktssyntese.

«Dravens Tales from the Crypt» har vært fortryllende i over 15 år med en smakløs blanding av humor, seriøs journalistikk – for aktuelle hendelser og ubalansert reportasje i pressepolitikken – og zombier, garnert med mye kunst, underholdning og punkrock. Draven har gjort hobbyen sin til et populært merke som ikke kan klassifiseres.

«Dravens Tales from the Crypt» har vært fortryllende i over 15 år med en smakløs blanding av humor, seriøs journalistikk – for aktuelle hendelser og ubalansert reportasje i pressepolitikken – og zombier, garnert med mye kunst, underholdning og punkrock. Draven har gjort hobbyen sin til et populært merke som ikke kan klassifiseres.